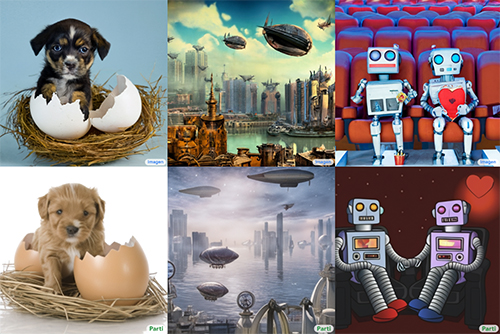

Fotos entstehen im Kopf und ihr Inhalt manifestiert die Kreativität sowie den Kommunikations- und Gestaltungswillen derjenigen, die sie produzieren. Jetzt soll es möglich werden, Bilder zu schaffen, die keine Abbildungen mehr sind, sondern reine Fantasie, beschrieben mit wenigen Worten. Die visuelle Umsetzung der Beschreibungen dieser fiktiven Vorstellungen und Szenen in ein fotoähnliches Bild, übernehmen die Algorithmen in Programme wie Parti oder Imagen von Google.

Bilder von Welpen in einem Nest, die aus einem zerbrochenen Ei schlüpfen. Fotos mit Blick auf eine Steampunk-Stadt mit Luftschiffen. Ein Bild von zwei Robotern, die einen romantischen Abend im Kino verbringen. Fotorealistische Bilder, die nur in der Fantasie von Kreativen existieren und die keiner je gesehen hat. Früher haben Maler, Zeichner oder Bildhauer sie Gestalt werden lassen. Doch nicht jeder hatte die Fähigkeit seiner Fantasie in Bilder Ausdruck zu verleihen. Erst die Fotografie half ihnen zumindest dabei, tatsächlich existierende Objekte oder Personen in perfekte visuelle Botschaften zu verwandeln. Jetzt sollen Menschen ohne Talent und Begabung zur Darstellung ihrer Fantasie mit Hilfe textlicher Beschreibungen als Vorlage Ausdruck verleihen können.

Das gibt es doch gar nicht: Welpen die aus dem Ei schlüpfen? Doch!

Die KI-gestützten „Text-to-Image“ Konzepte von Google Parti und

Imagen erzeuen fotorealistische Bilder aus Texten.

Wissenschaftler und Ingenieure bei Google haben nun die Text-zu-Bild-Generierung mit verschiedenen KI-Techniken erforscht. Nach umfangreichen Tests ist es ihnen gelungen zwei neuartige Text-zu-Bild-Modelle zu entwickeln: Imagen und Parti. Beide sind in der Lage, fotorealistische Bilder zu erzeugen, verwenden aber laut Google unterschiedliche Ansätze.

Das Prinzip der Text-Bild-Verfahren nutzt eine Textbeschreibung, auf deren Basis sie Bilder erzeugen, die der Textbeschreibung möglichst nahe kommen. Einfache Beispiele dafür sind Worte wie „ein Apfel“ oder „eine Katze, die auf einer Couch sitzt“ bis hin zu komplexeren Details, Interaktionen und beschreibenden Indikatoren wie „ein süßes Faultier, das eine kleine Schatztruhe hält. Ein helles, goldenes Leuchten geht von der Truhe aus.“

Ein Bild von einem niedlichen Faultier, das eine kleine Schatztruhe hält.

Ein helles goldenes Leuchten kommt aus der Truhe.

In den letzten Jahren wurden ML-Modelle auf großen Bilddatensätzen mit entsprechenden Textbeschreibungen trainiert, was zu einer höheren Bildqualität und einer breiteren Palette von Beschreibungen führte. Dies hat zu bedeutenden Durchbrüchen in diesem Bereich geführt, darunter DALL-E 2 von Open AI.

Wie Imagen und Parti funktionieren

Die Google Lösungen Imagen und Parti bauen auf früheren Modellen auf was Google in seinem Research Blog folgendermaßen beschreibt:

„Transformer-Modelle sind in der Lage, Wörter im Verhältnis zueinander in einem Satz zu verarbeiten. Sie sind die Grundlage dafür, wie wir Text in unseren Text-Bild-Modellen darstellen. Beide Modelle verwenden auch eine neue Technik, mit deren Hilfe Bilder erzeugt werden, die der Textbeschreibung besser entsprechen. Während Imagen und Parti eine ähnliche Technologie verwenden, verfolgen sie unterschiedliche, aber komplementäre Strategien.

Imagen ist ein Diffusionsmodell, das lernt, ein Muster aus zufälligen Punkten in Bilder umzuwandeln. Diese Bilder beginnen mit einer niedrigen Auflösung und werden dann schrittweise immer höher aufgelöst. In letzter Zeit waren Diffusionsmodelle sowohl bei Bild- als auch bei Audioaufgaben erfolgreich, z. B. bei der Verbesserung der Bildauflösung, der Neueinfärbung von Schwarz-Weiß-Fotos, der Bearbeitung von Bildbereichen, dem Freistellen von Bildern und der Synthese von Text in Sprache.

Der Ansatz von Parti wandelt zunächst eine Sammlung von Bildern in eine Folge von Code-Einträgen um, ähnlich wie Puzzleteile. Eine gegebene Textaufforderung wird dann in diese Code-Einträge übersetzt und ein neues Bild wird erstellt. Dieser Ansatz nutzt die Vorteile der bestehenden Forschung und Infrastruktur für große Sprachmodelle wie PaLM und ist entscheidend für die Handhabung langer, komplexer Texteingaben und die Erzeugung hochwertiger Bilder.

Diese Modelle haben viele Einschränkungen. So können sie weder zuverlässig die Anzahl von Objekten ermitteln (z. B. „zehn Äpfel“) noch diese auf der Grundlage bestimmter räumlicher Beschreibungen korrekt zuordnen (z. B. „eine rote Kugel links von einem blauen Block mit einem gelben Dreieck darauf“). Je komplexer die Aufforderungen werden, desto mehr geraten die Modelle ins Stocken, weil entweder Details fehlen oder Details eingeführt werden, die in der Aufforderung nicht vorgesehen waren. Diese Verhaltensweisen sind das Ergebnis mehrerer Mängel, darunter das Fehlen expliziten Schulungsmaterials, die begrenzte Datendarstellung und das fehlende 3D-Bewusstsein. Wir hoffen, diese Lücken durch breitere Darstellungen und eine effektivere Integration in den Prozess der Text-Bild-Erzeugung zu schließen.

Ein verantwortungsvoller Umgang mit Imagen und Parti

Text-zu-Bild-Modelle sind spannende Werkzeuge für Inspiration und Kreativität. Sie bergen aber auch Risiken in Bezug auf Desinformation, Voreingenommenheit und Sicherheit. Wir führen Diskussionen über verantwortungsvolle KI-Praktiken und die notwendigen Schritte, um diese Technologie sicher einzusetzen. In einem ersten Schritt verwenden wir leicht identifizierbare Wasserzeichen, um sicherzustellen, dass die Menschen ein von Imagen oder Parti generiertes Bild immer erkennen können. Wir führen auch Experimente durch, um die Verzerrungen der Modelle, z. B. bei der Darstellung von Menschen und Kulturen, besser zu verstehen und mögliche Abhilfemaßnahmen zu erforschen. In den Papieren von Imagen und Parti werden diese Fragen ausführlich erörtert.

Wie geht es weiter mit den Text-Bild-Modellen bei Google?

Wir werden neue Ideen vorantreiben, die das Beste aus beiden Modellen vereinen, und uns mit verwandten Aufgaben befassen, z. B. mit der Möglichkeit, Bilder interaktiv durch Text zu erzeugen und zu bearbeiten. Außerdem führen wir weiterhin eingehende Vergleiche und Bewertungen durch, um unsere Grundsätze für verantwortungsvolle KI zu erfüllen. Unser Ziel ist es, auf diesen Modellen basierende Nutzererfahrungen auf sichere, verantwortungsvolle und kreativitätsfördernde Weise in die Welt zu bringen.“

Gestern wurde in den USA der National Camera Day gefeiert, einer der vielen Feiertage, von denen niemand weiß -außer vielleicht die Marketing Manager der Kameraindustrie und des Fotohandels – wer sie initiiert hat und warum. Vielleicht werden künftige Generationen sagen, das hat seinen Ursprung als damals vor langer Zeit, als noch Kameras benötig waren, um realistische Abbildungen zu schaffen.

Mehr dazu erfahren Sie hier…